متا محدودیتهای پیامرسانی نوجوانان و کنترلهای والدین را سختتر میکند

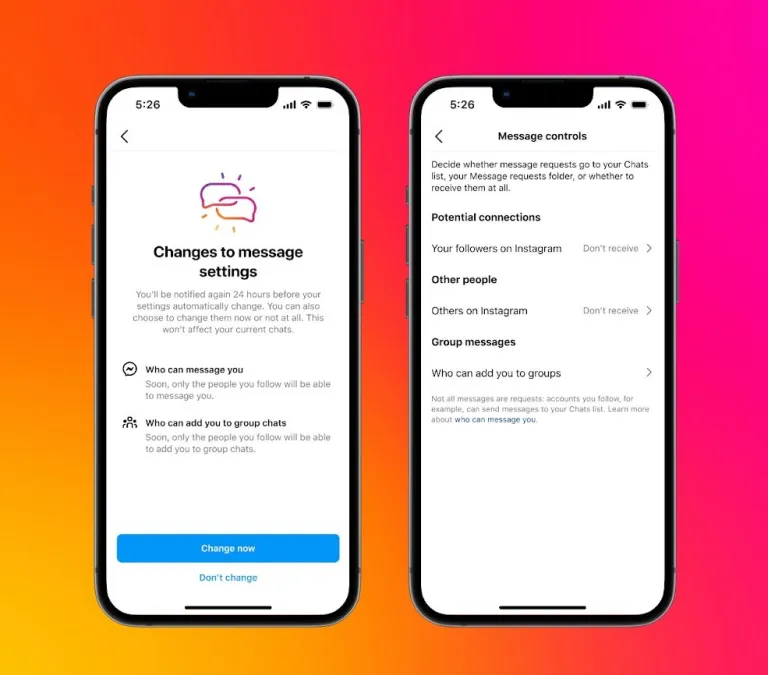

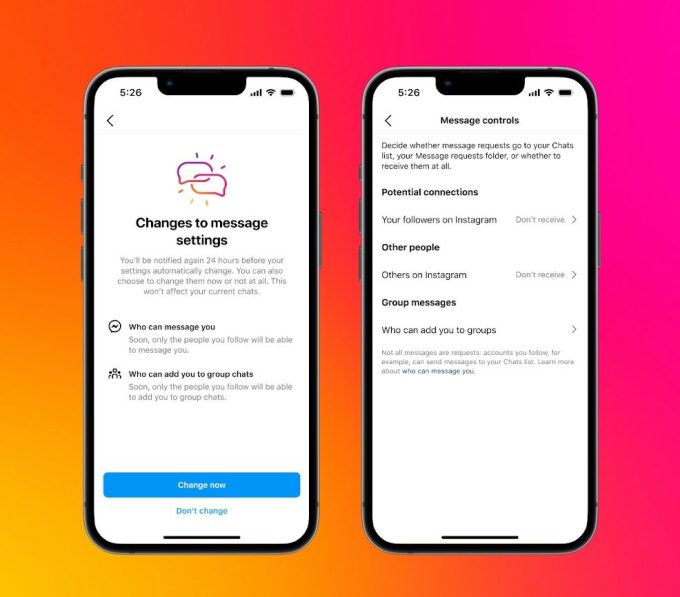

به گزارش اپ خونه، متا اعلام کرد که محدودیتهای جدید DM را در فیسبوک و اینستاگرام برای نوجوانان اعمال میکند که مانع از ارسال پیام به نوجوانان میشود.

تا به حال، اینستاگرام بزرگسالان بالای ۱۸ سال را از ارسال پیام به نوجوانانی که آنها را فالو نمی کنند، محدود می کند.

محدودیت های جدید به طور پیش فرض برای همه کاربران زیر ۱۶ سال – و در برخی مناطق جغرافیایی زیر ۱۸ سال – اعمال می شود. متا گفت که با یک اعلان به کاربران فعلی اطلاع خواهد داد.

در مسنجر، کاربران فقط از دوستان فیس بوک یا افرادی که در مخاطبین خود دارند، پیام دریافت می کنند.

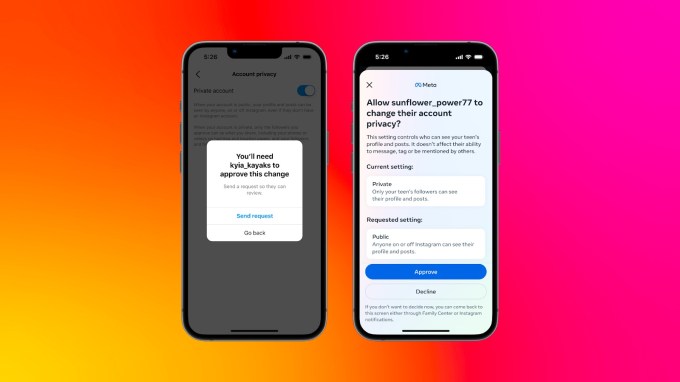

علاوه بر این، متا همچنین با اجازه دادن به سرپرستان برای اجازه یا رد تغییرات در تنظیمات حریم خصوصی پیش فرض ایجاد شده توسط نوجوانان، کنترل های والدین خود را قوی تر می کند.

قبلاً، وقتی نوجوانان این تنظیمات را تغییر میدادند، قیمها اعلانی دریافت میکردند ، اما نمیتوانستند هیچ اقدامی در مورد آنها انجام دهند.

این شرکت مثالی ارائه کرد که اگر یک کاربر نوجوان بخواهد حساب خود را از حالت خصوصی عمومی کند، کنترل محتوای حساس را از «کمتر» به «استاندارد» تغییر دهد، یا تلاش کند کنترلهایی را در مورد افرادی که میتوانند به او پیام ارسال کنند تغییر دهد، سرپرستان میتوانند او را مسدود کنند.

متا برای اولین بار در سال ۲۰۲۲ ابزارهای نظارت والدین را برای اینستاگرام عرضه کرد که به سرپرستان اجازه نظارت استفاده نوجوانان خود را می داد.

این غول رسانههای اجتماعی همچنین در حال برنامهریزی برای راهاندازی قابلیتی است که از دیدن تصاویر ناخواسته و نامناسب نوجوانان در DM های ارسالی توسط افراد مرتبط با آنها جلوگیری میکند.

این شرکت اضافه کرد که این ویژگی در چتهای رمزگذاریشده سرتاسر نیز کار میکند و نوجوانان را از ارسال این نوع تصاویر منصرف میکند.

متا مشخص نکرد که چه کاری برای اطمینان از حریم خصوصی نوجوانان در هنگام اجرای این ویژگی ها انجام می دهد. همچنین جزئیاتی در مورد آنچه که «نامناسب» میداند ارائه نکرده است.

در اوایل این ماه، متا ابزارهای جدیدی را برای محدود کردن نوجوانان از نگاه کردن به خودآزاری یا اختلالات خوردن در فیس بوک و اینستاگرام ارائه کرد .

ماه گذشته، متا یک درخواست رسمی برای اطلاعات از قانونگذاران اتحادیه اروپا دریافت کرد که از شرکت خواسته شد جزئیات بیشتری در مورد تلاشهای شرکت در جلوگیری از به اشتراکگذاری مواد آزار کودکان (SG-CSAM) ارائه دهد.

در ماه اکتبر، بیش از ۴۰ ایالت آمریکا در دادگاه فدرال در کالیفرنیا شکایت کردند و این شرکت را متهم کردند که محصولاتی را به گونهای طراحی میکند که به سلامت روان کودکان آسیب میرساند.

این شرکت قرار است در ۳۱ ژانویه سال جاری به همراه سایر شبکه های اجتماعی از جمله TikTok، Snap، Discord و X (توئیتر سابق) در برابر سنا در مورد مسائل مربوط به ایمنی کودکان شهادت دهد.