به گزارش اپ خونه، همانطور که یک نویسنده نسبتاً موفق تجاری نوشت: “شب تاریک و پر از وحشت است، روز روشن و زیبا و پر از امید.” این تصویرسازی مناسب برای هوش مصنوعی است، که مانند تمام فناوریها جنبههای مثبت و منفی خود را دارد.

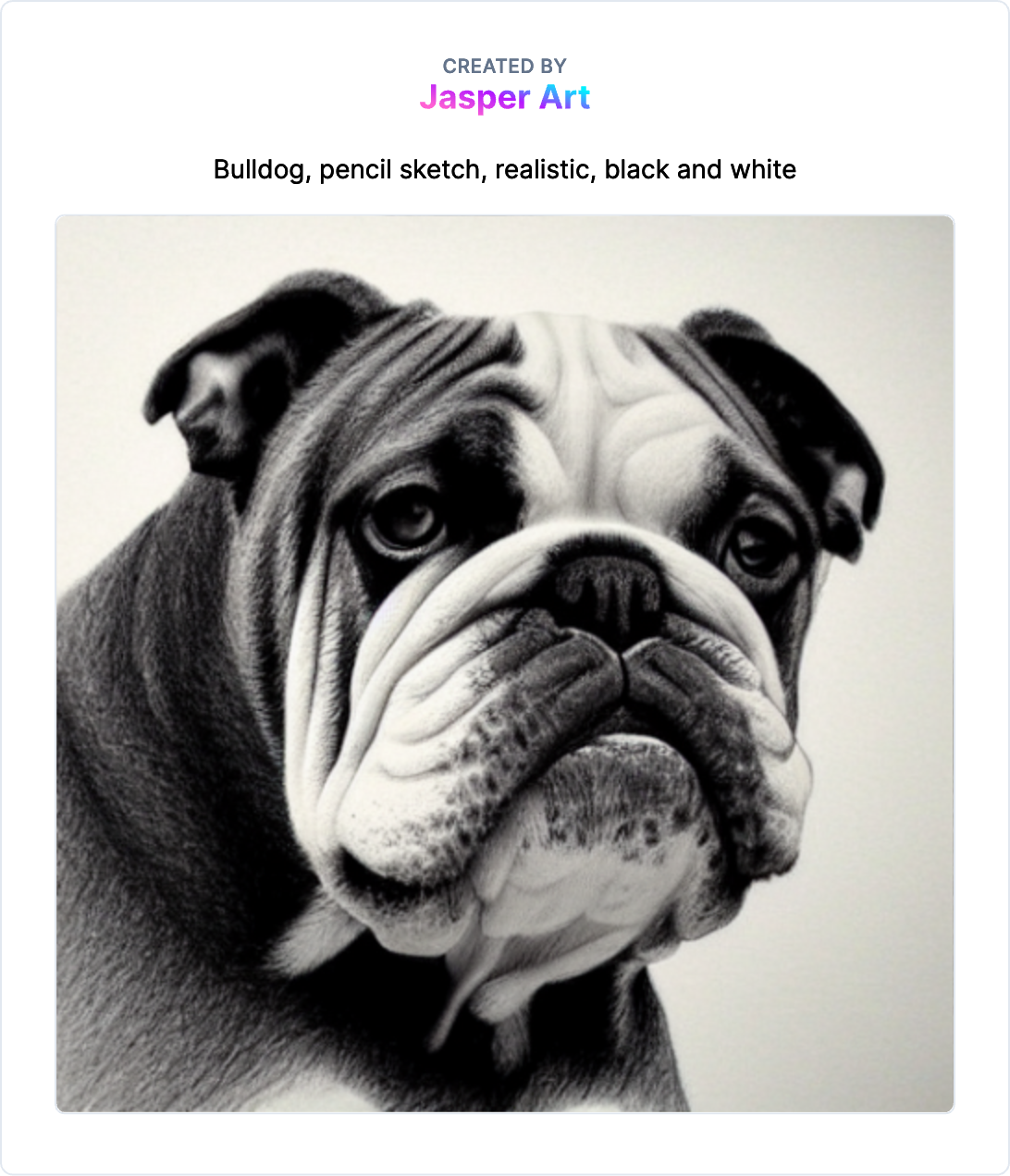

به عنوان مثال، مدلهای مولد هنر مانند Stable Diffusion، منجر به هجوم باورنکردنی خلاقیت، برنامهها و حتی مدلهای کاملاً جدید کسبوکار شدهاند.

از سوی دیگر، ماهیت متن باز آن به بازیگران بد اجازه می دهد تا از آن برای ایجاد دیپ فیک در مقیاس بزرگ استفاده کنند – در حالی که هنرمندان اعتراض می کنند که این کار از کارشان سود می برد.

چه چیزی برای هوش مصنوعی در سال ۲۰۲۳ وجود دارد؟ آیا مقررات بدترین چیزی را که هوش مصنوعی به ارمغان می آورد مهار می کند یا دروازه های سیل باز هستند؟ آیا اشکال جدید و قدرتمند و متحول کننده هوش مصنوعی ظهور خواهند کرد، در ChatGPT که صنایعی را که زمانی تصور می شد از اتوماسیون در امان بودند، مختل کند؟

منتظر برنامههای هوش مصنوعی (مشکلساز) بیشتری باشید که هنر تولید میکنند

با موفقیت Lensa، برنامه سلفی مجهز به هوش مصنوعی از Prisma Labs که در فضای مجازی منتشر شد، میتوانید برنامههای من-توی زیادی را در این راستا انتظار داشته باشید.

ماکسیمیلیان گانتز، محقق ارشد سیاستگذاری در بنیاد موزیلا، گفت که انتظار دارد ادغام هوش مصنوعی مولد در فناوری مصرف کننده، تأثیرات چنین سیستم هایی را، چه خوب و چه بد، تقویت کند.

برای مثال، Stable Diffusion به میلیاردها تصویر از اینترنت داده شد تا زمانی که “یاد گرفت” کلمات و مفاهیم خاص را با تصاویر خاص مرتبط کند.

مدلهای تولید متن معمولاً به راحتی فریب داده میشوند تا از دیدگاههای توهینآمیز حمایت کنند یا محتوای گمراهکننده تولید کنند.

مایک کوک، یکی از اعضای گروه تحقیقاتی باز چاقوها و قلموها، با گانتس موافق است که هوش مصنوعی مولد به اثبات نیروی اصلی – و مشکلساز – برای تغییر ادامه خواهد داد.

اما او فکر میکند که سال ۲۰۲۳ باید سالی باشد که هوش مصنوعی مولد «در نهایت پول خود را به جایی میرساند».

مدل توسط Stability AI، ایجاد شده در ابزار رایگان Dream Studio

انگیزه دادن به جامعه ای از متخصصان [برای ایجاد فناوری جدید] کافی نیست – برای اینکه فناوری به بخشی طولانی مدت از زندگی ما تبدیل شود، یا باید برای کسی پول زیادی داشته باشد، یا تأثیر معناداری بر زندگی روزمره داشته باشد.

کوک گفت.. « بنابراین من پیشبینی میکنم که ما شاهد یک فشار جدی برای ایجاد هوش مصنوعی مولد در واقع به یکی از این دو چیز با موفقیت متفاوت باشیم.»

هنرمندان تلاش برای انصراف از مجموعه داده ها را رهبری می کنند

DeviantArt یک مولد هنری هوش مصنوعی را منتشر کرد که بر اساس Stable Diffusion و بر روی آثار هنری جامعه DeviantArt تنظیم شده بود.

مولد هنر با مخالفت شدید ساکنان قدیمی DeviantArt مواجه شد، که از عدم شفافیت پلت فرم در استفاده از هنر آپلود شده خود برای آموزش سیستم انتقاد کردند.

سازندگان محبوب ترین سیستم ها – OpenAI و Stability AI – می گویند که اقداماتی را برای محدود کردن میزان محتوای مضر تولید شده توسط سیستم هایشان انجام داده اند.

اما با قضاوت بسیاری از نسلها در رسانههای اجتماعی، واضح است که کارهایی برای انجام دادن وجود دارد.

گانتس با مقایسه این فرآیند با بحثهای جاری بر سر تعدیل محتوا در رسانههای اجتماعی، گفت: «مجموعههای دادهها برای رسیدگی به این مشکلات نیاز به نظارت فعال دارند و باید مورد بررسی جدی قرار گیرند، از جمله از سوی جوامعی که تمایل به گرفتن پایان کوتاه دارند.»

هوش مصنوعی پایداری که عمدتاً بودجه توسعه Stable Diffusion را تأمین می کند، اخیراً در برابر فشار عمومی تسلیم شد و نشان داد که به هنرمندان اجازه می دهد از مجموعه داده های مورد استفاده برای آموزش نسل بعدی مدل Stable Diffusion صرف نظر کنند.

از طریق وب سایت HaveIBeenTrained.com، دارندگان حقوق می توانند قبل از شروع آموزش تا چند هفته دیگر درخواست انصراف دهند.

OpenAI چنین مکانیزم انصرافی را ارائه نمی دهد، در عوض ترجیح می دهد با سازمان هایی مانند Shutterstock شریک شود تا بخشی از گالری تصاویر خود را مجوز دهد.

اما با توجه به مخالفتهای قانونی و تبلیغاتی محض که در کنار هوش مصنوعی پایداری با آن روبهرو است، به احتمال زیاد فقط زمان زیادی است که آن را دنبال کند.

دادگاه ها در نهایت ممکن است دست آن را به زور بیاورند. در ایالات متحده، مایکروسافت، GitHub و OpenAI در یک دادخواست دسته جمعی مورد شکایت قرار می گیرند که آنها را متهم به نقض قانون کپی رایت با اجازه دادن به Copilot، سرویس GitHub که به طور هوشمند خطوط کد را پیشنهاد می کند، بخش هایی از کد مجوز را بدون ارائه اعتبار بازگرداند.

شاید با پیشبینی چالش قانونی، GitHub اخیراً تنظیماتی را برای جلوگیری از نمایش کد عمومی در پیشنهادات Copilot اضافه کرده و قصد دارد ویژگیای را معرفی کند که به منبع پیشنهادات کد اشاره میکند.

اما آنها اقدامات ناقصی هستند. حداقل در یک مورد، تنظیمات فیلتر باعث شد که Copilot تکههای بزرگی از کدهای دارای حق نسخهبرداری را منتشر کند، از جمله تمام متن اسناد و مجوز.

انتظار می رود در سال آینده شاهد افزایش انتقادات باشیم، به ویژه زمانی که بریتانیا قوانینی را در نظر می گیرد که الزام استفاده از سیستم های آموزش دیده از طریق داده های عمومی را کاملاً غیرتجاری حذف می کند.

تلاش های منبع باز و غیرمتمرکز به رشد خود ادامه خواهند داد

در سال ۲۰۲۲ تعداد انگشت شماری از شرکت های هوش مصنوعی، عمدتا OpenAI و Stability AI بر صحنه تسلط داشتند.

اما آونگ ممکن است در سال ۲۰۲۳ به سمت منبع باز بازگردد، زیرا توانایی ساخت سیستم های جدید فراتر از “آزمایشگاه های غنی از منابع و قدرتمند هوش مصنوعی” حرکت می کند، همانطور که Gahntz گفت.

یک رویکرد اجتماعی ممکن است منجر به بررسی دقیقتر سیستمها در حین ساخت و استقرار آنها شود. نقص ها و آسیب های مرتبط با هوش مصنوعی مولد و اغلب انجام آن بسیار دشوار است.

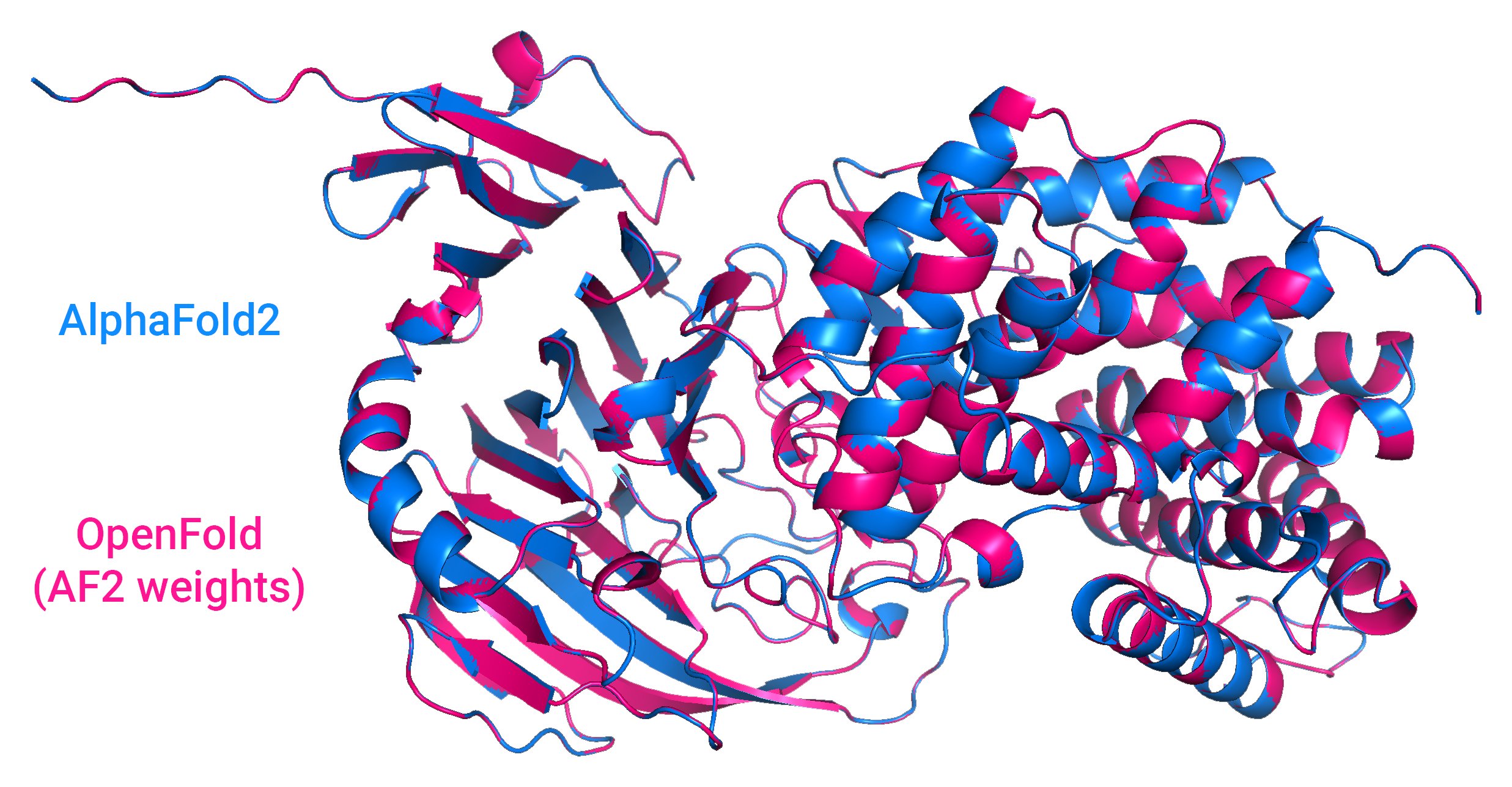

نتایج OpenFold، یک سیستم AI منبع باز که شکل پروتئین ها را در مقایسه با AlphaFold2 DeepMind پیش بینی می کند

نمونههایی از این تلاشهای متمرکز بر جامعه شامل مدلهای زبان بزرگ EleutherAI و BigScience است، تلاشی که توسط استارتآپ Hugging Face پشتیبانی میشود.

هوش مصنوعی پایداری خود تعدادی از جوامع مانند Harmonai متمرکز بر نسل موسیقی و OpenBioML، مجموعهای آزاد از آزمایشهای بیوتکنولوژی را تامین میکند.

برای آموزش و اجرای مدلهای پیشرفته هوش مصنوعی همچنان به پول و تخصص نیاز است، اما محاسبات غیرمتمرکز ممکن است مراکز داده سنتی را با بلوغ تلاشهای منبع باز به چالش بکشد.

BigScience با انتشار اخیر پروژه منبع باز Petals، گامی در جهت امکان توسعه غیرمتمرکز برداشت. Petals به افراد این امکان را میدهد که قدرت محاسباتی خود را، مشابه Folding@home، برای اجرای مدلهای بزرگ زبان هوش مصنوعی که معمولاً به یک GPU یا سرور پیشرفته نیاز دارند، به اشتراک بگذارند.

مدلهای مولد مدرن آموزش و اجرا از نظر محاسباتی گران هستند. چاندرا باگاواتولا، دانشمند تحقیقاتی ارشد در مؤسسه هوش مصنوعی آلن، از طریق ایمیل گفت: برخی از برآوردهای پشت پاکت، هزینه روزانه ChatGPT را به حدود ۳ میلیون دلار می رساند. برای اینکه این امر از نظر تجاری قابل دوام و در دسترس بیشتر باشد، رسیدگی به این امر بسیار مهم خواهد بود.

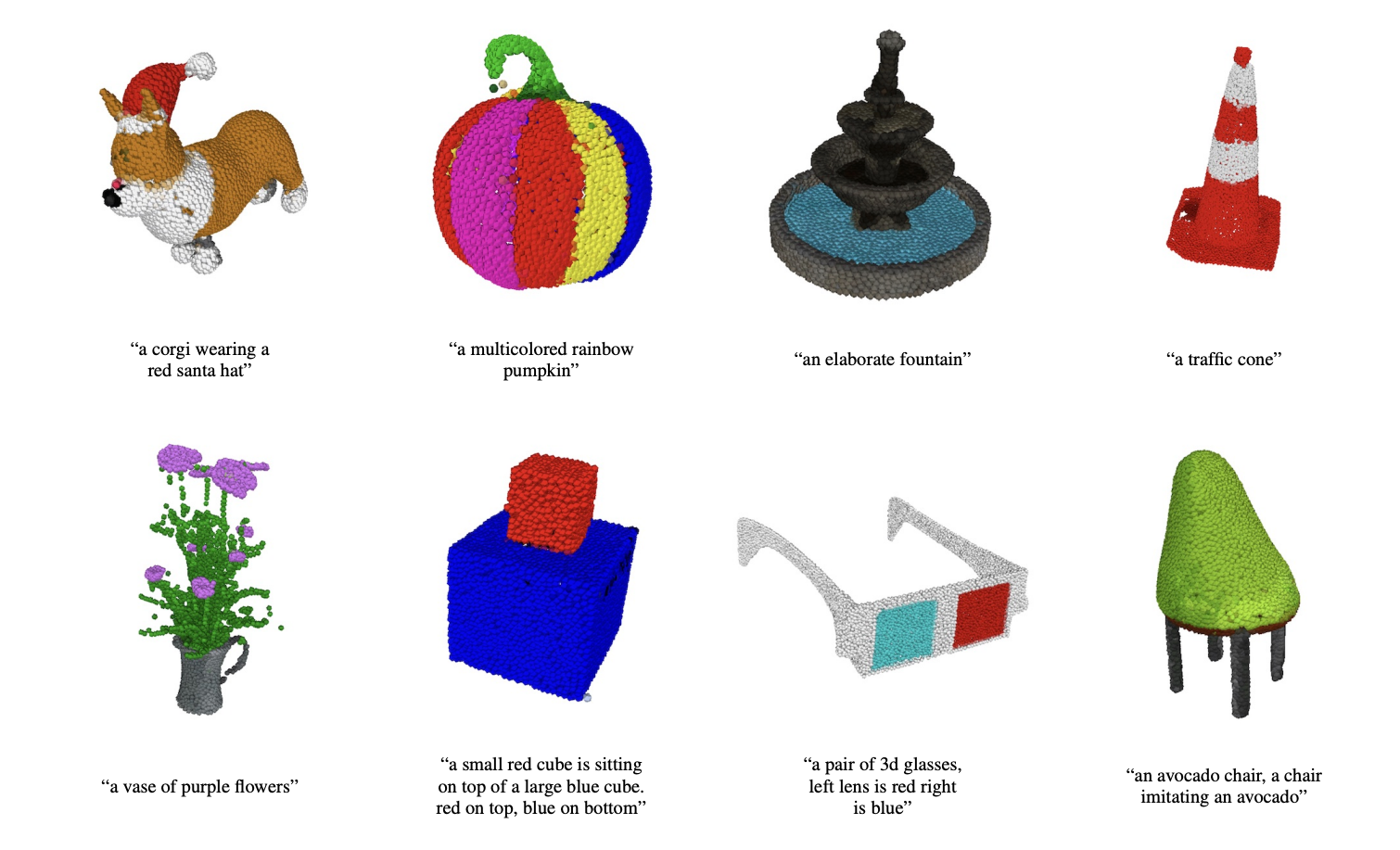

با این حال چاندرا خاطرنشان میکند که آزمایشگاههای بزرگ تا زمانی که روشها و دادههای اختصاصی باقی بمانند، مزیتهای رقابتی خواهند داشت. در یک مثال اخیر، OpenAI Point-E را منتشر کرد، مدلی که میتواند اشیاء سهبعدی را با یک پیام متنی تولید کند.

اما در حالی که OpenAI این مدل را منبع باز کرد، منابع داده های آموزشی Point-E را فاش نکرد یا آن داده ها را منتشر نکرد.

Point-E ابرهای نقطه ای تولید می کند

چاندرا گفت:

«من فکر میکنم تلاشهای منبع باز و تلاشهای تمرکززدایی کاملاً ارزشمند هستند و به نفع تعداد بیشتری از محققان، پزشکان و کاربران است. با این حال، با وجود منبع باز بودن، بهترین مدلها به دلیل محدودیتهای منابع، هنوز برای تعداد زیادی از محققان و متخصصان غیرقابل دسترسی هستند.»

شرکتهای هوش مصنوعی به خاطر مقررات دریافتی دست و پنجه نرم میکنند

مقرراتی مانند قانون هوش مصنوعی اتحادیه اروپا ممکن است نحوه توسعه و استقرار سیستمهای هوش مصنوعی شرکتها را تغییر دهد.

بنابراین، تلاشهای محلی بیشتر، مانند قانون استخدام هوش مصنوعی در شهر نیویورک، که مستلزم آن است که هوش مصنوعی و فناوری مبتنی بر الگوریتم برای استخدام، استخدام یا ارتقاء پیش از استفاده از نظر سوگیری ممیزی شود.

چاندرا این مقررات را ضروری میبیند، بهویژه با توجه به نقصهای فنی آشکار و آشکار هوش مصنوعی مولد، مانند تمایل آن به افشای اطلاعات واقعی اشتباه.

این امر استفاده از هوش مصنوعی مولد را برای بسیاری از حوزههایی که اشتباهات میتوانند هزینههای بسیار بالایی داشته باشند، دشوار میکند – به عنوان مثال. مراقبت های بهداشتی.

علاوه بر این، سهولت تولید اطلاعات نادرست، چالش هایی را پیرامون اطلاعات نادرست و اطلاعات نادرست ایجاد می کند. «[و با این حال] سیستمهای هوش مصنوعی در حال حاضر تصمیماتی مملو از پیامدهای اخلاقی و اخلاقی میگیرند.»

با این حال، سال آینده فقط تهدید مقررات را به همراه خواهد داشت – قبل از اینکه کسی جریمه شود یا متهم شود، انتظار می رود که در مورد قوانین و پرونده های قضایی بیشتر بحث شود. اما ممکن است شرکتها همچنان در سودمندترین دستهبندیهای قوانین آتی، مانند دستههای ریسک قانون هوش مصنوعی، به دنبال موقعیت باشند.

این قانون همانطور که در حال حاضر نوشته شده است، سیستمهای هوش مصنوعی را به یکی از چهار دسته خطر تقسیم میکند که هر کدام دارای الزامات و سطوح بررسی متفاوت هستند.

سیستمهایی که در بالاترین رده خطر، هوش مصنوعی «پرخطر» (مانند الگوریتمهای امتیازدهی اعتبار، اپلیکیشنهای جراحی رباتیک)، باید استانداردهای قانونی، اخلاقی و فنی خاصی را پیش از ورود به بازار اروپا رعایت کنند.

پایینترین طبقهبندی، هوش مصنوعی «کم یا بدون خطر» (مانند فیلترهای هرزنامه، بازیهای ویدیویی مجهز به هوش مصنوعی)، تنها تعهدات شفافسازی را تحمیل میکند، مانند آگاه کردن کاربران از اینکه با یک سیستم هوش مصنوعی در تعامل هستند.

اوس کیز، کاندیدای دکترا در دانشگاه واشنگتن، ابراز نگرانی کرد که شرکتها به منظور به حداقل رساندن مسئولیتها و دیده شدن خود در برابر قانونگذاران، پایینترین سطح ریسک را در نظر خواهند گرفت.

آنها گفتند: «این نگرانی به کنار، [قانون هوش مصنوعی] واقعاً مثبت ترین چیزی است که روی میز می بینم. من چیز زیادی از کنگره ندیده ام.»

اما سرمایه گذاری چیز مطمئنی نیست

گانتس استدلال می کند که حتی اگر یک سیستم هوش مصنوعی برای اکثر مردم به اندازه کافی خوب کار کند اما برای برخی عمیقاً مضر باشد، قبل از اینکه یک شرکت آن را به طور گسترده در دسترس قرار دهد، «هنوز تکالیف زیادی باقی مانده است».

«یک مورد تجاری نیز برای همه اینها وجود دارد. اگر مدل شما چیزهای آشفته زیادی تولید کند، مصرف کنندگان آن را دوست نخواهند داشت. اما بدیهی است که این نیز در مورد انصاف است.»

مشخص نیست که آیا شرکتها با این استدلال در سال آینده متقاعد خواهند شد، به خصوص که به نظر میرسد سرمایهگذاران مشتاق هستند که پول خود را فراتر از هر هوش مصنوعی مولد امیدوارکننده بگذارند.

در بحبوحه بحثهای Stable Diffusion، هوش مصنوعی پایداری ۱۰۱ میلیون دلار با ارزش بیش از ۱ میلیارد دلار از حامیان برجسته از جمله Coatue و Lightspeed Venture Partners جمعآوری کرد.

گفته می شود که OpenAI با ورود به مذاکرات پیشرفته برای جمع آوری بودجه بیشتر از مایکروسافت، ۲۰ میلیارد دلار ارزش دارد. (مایکروسافت قبلاً ۱ میلیارد دلار در OpenAI در سال ۲۰۱۹ سرمایه گذاری کرده بود.)

البته اینها می توانند استثناهایی از قاعده باشند.

بر اساس گزارش Crunchbase، خارج از شرکتهای خودران Cruise، Wayve و WeRide و شرکت رباتیک MegaRobo، شرکتهای برتر هوش مصنوعی از نظر پول جمعآوریشده در سال جاری مبتنی بر نرمافزار بودند.

Contentsquare که سرویسی را می فروشد که توصیه های مبتنی بر هوش مصنوعی را برای محتوای وب ارائه می دهد، یک دور ۶۰۰ میلیون دلاری را در ماه جولای بسته است.

Uniphore که نرمافزار «تحلیل مکالمه» (متریک مرکز تماس فکر کنید) و دستیاران مکالمه را میفروشد، در ماه فوریه ۴۰۰ میلیون دلار به دست آورد. در همین حال، Highspot، که پلتفرم مبتنی بر هوش مصنوعی آن، توصیههای همزمان و مبتنی بر داده را به نمایندگان فروش و بازاریابان ارائه میدهد، در ژانویه ۲۴۸ میلیون دلار به دست آورد.

سرمایهگذاران ممکن است به دنبال شرطبندیهای ایمنتر مانند تجزیه و تحلیل خودکار شکایات مشتریان یا ایجاد سرنخهای فروش باشند، حتی اگر اینها به اندازه هوش مصنوعی مولد جذاب نباشند. این بدان معنا نیست که سرمایهگذاریهای قابل توجهی وجود نخواهد داشت، اما این سرمایهگذاریها برای بازیکنان با نفوذ در نظر گرفته میشود.